La AESIA desempeñará un papel crucial en la coordinación de las políticas en materia de IA, asegurando una adecuada protección de los derechos fundamentales

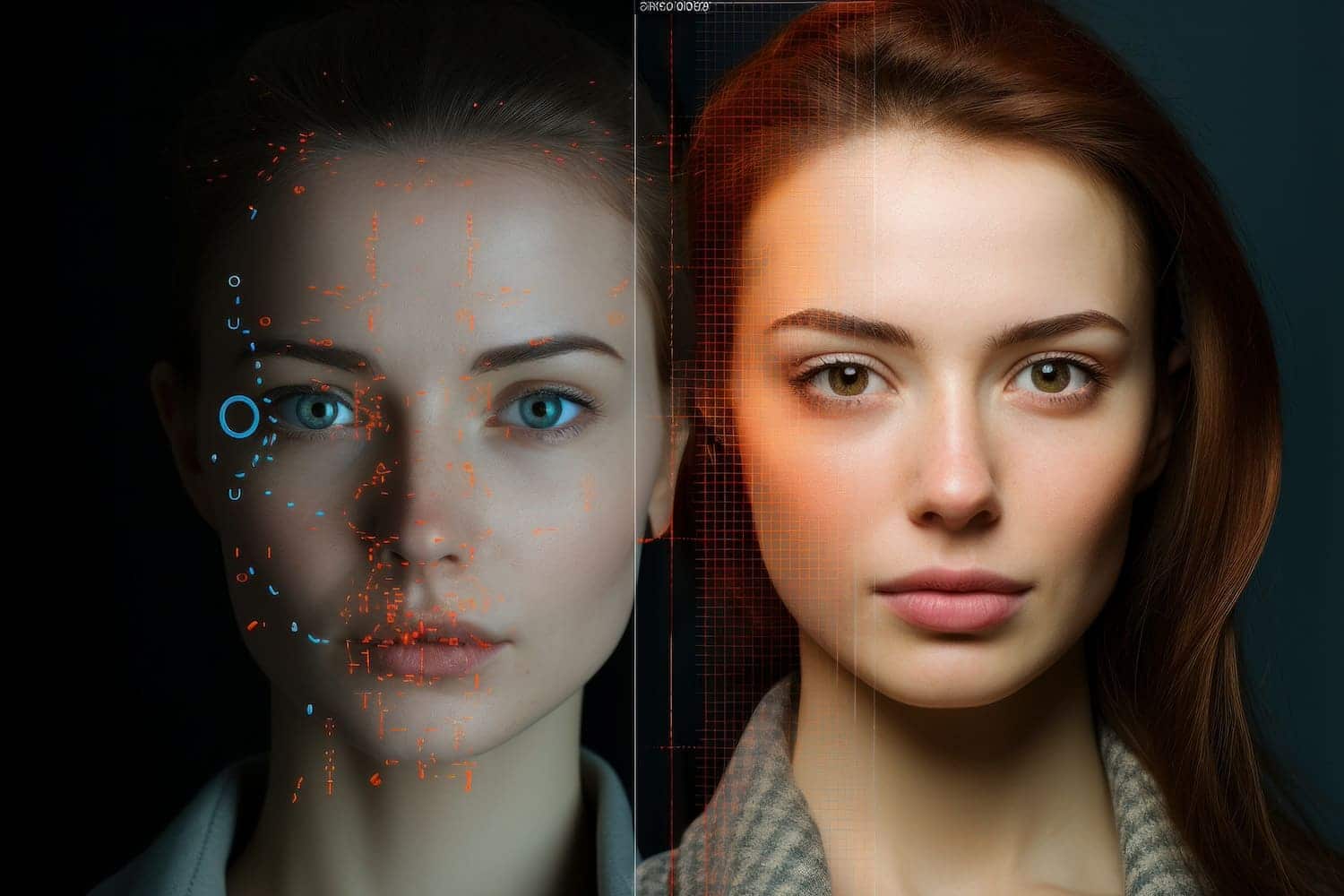

La amenaza creciente de los deepfakes

Conocidos por su papel en actividades fraudulentas, incluido el uso de identificaciones falsas o robadas, los deepfakes han causado enormes daños en el sector financiero, con pérdidas estimadas en 3.400 millones de dólares.

L

os deepfakes se están convirtiendo en una amenaza cada vez más grave para las empresas. El 80% de las organizaciones reconoce los riesgos potenciales que plantea esta tecnología. Su capacidad para eludir pruebas de vida tradicionales resalta los rápidos avances que experimenta este fenómeno y los desafíos cada vez mayores que supone para los marcos de seguridad existentes.

Condicionantes que explican el éxito de los deepfakes

La propagación de los deepfakes está impulsada por varios factores que simplifican su creación y aumentan su efectividad. La disponibilidad de software gratuito y de código abierto ha hecho que estas herramientas sean accesibles para un público más amplio, reduciendo drásticamente la barrera de entrada. Además, los bajos costos de producir falsificaciones de alta calidad han facilitado la creación generalizada de contenido fraudulento.

Los deepfakes representan un desafío particular para las medidas de seguridad convencionales debido a su capacidad para escapar de la detección por parte de los humanos, lo que los convierte en herramientas efectivas para la desinformación y el fraude.

Los ataques digitales inducidos por deepfakes suelen adoptar la forma de ataques de presentación o ataques de inyección. Los ataques de presentación engañan a los sistemas biométricos con fotos manipuladas, videos o máscaras físicas para autenticar identidades falsas. Por el contrario, los ataques de inyección alteran datos a través de varios métodos, como el uso de cámaras virtuales, la vulneración de APIs o SDKs de proveedores o la manipulación de datos en tránsito. Estas tácticas subrayan la creciente complejidad y diversidad de las técnicas de estos fraudes digitales.

Contrarrestar las amenazas es un trabajo conjunto

Para detectar y contrarrestar eficazmente estas amenazas, las empresas deben adoptar una combinación de medidas de seguridad avanzadas y técnicas de aprendizaje automático. Las estrategias efectivas implican detectar inconsistencias como elementos de fondo recurrentes, errores de microimpresión en documentos y poses idénticas en diferentes imágenes. Detectar movimientos sutiles no naturales y discrepancias en las transmisiones de video también es crucial para identificar fraudes con cámaras virtuales.

A medida que los deepfakes se vuelven más sofisticados, un enfoque proactivo y tecnológicamente avanzado es crucial para una protección completa. Las empresas están recurriendo cada vez más a la biometría multimodal que incorpora varios indicadores, como señales faciales y vocales, para reforzar la seguridad. Las técnicas avanzadas de detección de vivacidad, que evalúan respuestas físicas y patrones de comportamiento, son vitales para identificar con mayor precisión las suplantaciones. Además, pasar de APIs a SDKs mejora el control sobre la captura de datos, y utilizar modelos de IA entrenados en diversos escenarios de ataque fortalece significativamente las defensas contra estas amenazas complejas.

En conclusión, la aparición de los deepfakes requiere una estrategia de defensa integral y sofisticada que vaya más allá de las medidas de seguridad tradicionales. Con la creciente accesibilidad de la tecnología deepfake y su mejor capacidad para evadir la detección, es imperativo que las empresas implementen técnicas avanzadas de aprendizaje automático, biometría multimodal y sistemas robustos de detección de vivacidad. Este enfoque proactivo es esencial para proteger las identidades digitales y asegurar las operaciones comerciales en el intrincado ámbito del fraude digital.

TrustCloud cuenta con las más avanzadas capacidades de detección de deepfakes en sus sistemas de video identificación.

Contacta con nosotros